封面新闻记者 刘叶

AI剧无疑是今年备受关注的艺术体裁,但随之而来的侵权问题也引起广泛关注,多名配音演员集体发布AI维权声明函一度登上微博热搜,在多份声明中,演员们呼吁设计侵权的个人、机构、公司或平台停止侵权行为,尊重配音演员的合法权益,连知名影视剧《甄嬛传》的“甄嬛”配音季冠霖也发文声讨。3月23日,毫达律师事务所孙顺发主任律师接受封面新闻记者采访时表示,配音被侵权定性有难度,及时留存证据更重要。

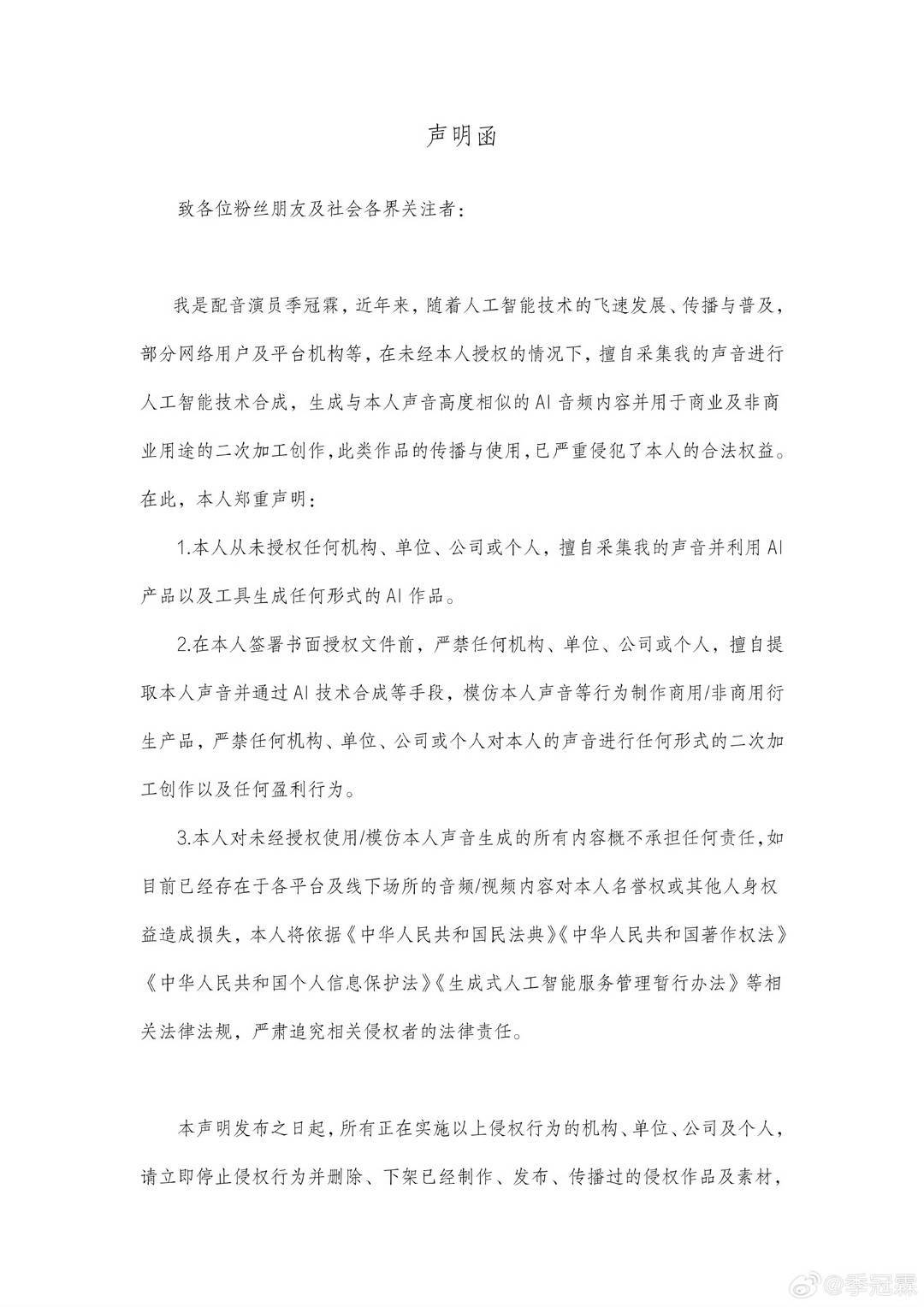

季冠霖的声明 图剧季冠霖微博

配音被侵权定性有难度

“非商用”不能成为避免处罚理由

配音演员维权的核心难度在于“声音权益的可识别性证明”与“侵权链条的锁定”。孙顺发介绍,“根据《民法典》,声音受保护的前提是具有可识别性(能指向特定自然人)。但在司法实践中标准不一。”第一种观点认为只要“一定范围内的公众”(如配音行业内的广告商、制作公司)能识别即可,无需达到家喻户晓的程度,但另外一种观点则要求“一般社会公众”能识别,对于非明星配音演员,若社会知名度不够,即使AI声音高度相似,也可能被认定为不构成侵权。

此外,还存在取证链条薄弱与“鉴定”难的问题。事实上,AI语音多为碎片化二次加工,声音没有实体,易被剪辑、变速,如果配音演员切换多种声线,而AI仅需微调音色即可做到“高度相似”而非“1:1复刻”,导致声纹鉴定报告在法庭上可能因与“公众感知”不符而不被采纳。

在取证方面,孙顺发分析道,“侵权方常以‘技术中立’或‘商业秘密’为由,拒绝披露AI模型训练是否使用了原告声音。若无法证明训练数据来源非法,被侵权人难以证明侵权成立。”

如果构成侵权,有哪些侵权方会担责?首先是未经授权使用他人声音的视频制作方,“是侵权的核心实施者,一般被判赔礼道歉并连带赔偿。”孙顺发说。如果是音频录制者若违规转卖声音数据,需承担侵权责任。对平台而言,如果没尽到审核义务,需承担相应责任。

如果侵权事实成立,侵权方要面对民事赔偿和人格权责任。在综合考虑侵权情节、产品价值、播放量等因素后,“通常需要侵权方承担停止侵害(下架产品)、消除影响以及书面赔礼道歉的责任。另外如果利用AI声音实施诈骗(如实时语音深度伪造诈骗成功率接近100%),可能构成诈骗罪等刑事犯罪。”孙顺发说。

另外,孙顺发介绍,学习交流或“非商用”,不能成为避免处罚的原因。

“换脸”“换声”区别大

及时留存证据更重要

AI侵权在配音和人脸领域存在显著差异,AI配音侵权“可识别性”标准模糊,需证明AI声音能指向特定人,但何为“可识别”在司法中存在宽严两种标准,“对非名人极不友好,声音看不见摸不着,AI微调音色即可规避1:1复刻认定,声纹报告有时不被采纳。”孙顺发说。 AI换脸侵权“可识别性”标准相对明确。人脸有固定生理特征,通过技术比对容易确定源头。

针对当前AI侵权的乱象,从法律治理和行业发展的角度,孙顺发提出以下建议:首先,建议最高人民法院通过司法解释或指导性案例,明确AI声音侵权的认定标准。特别是统一“可识别性”的判定尺度(如采用“相关公众”标准而非“一般公众”标准),并明确声纹鉴定报告的法律效力。其次,建立强制溯源与标识机制。推广AI生成内容的水印技术和溯源机制,建立跨部门的检测预警平台。要求AI服务提供商必须记录并披露训练数据的合法来源,避免以“商业秘密”为由规避举证责任。再次,平台商家委托达人带货时,对AI合成声音负有“来源合法性核查”义务,未尽义务需承担连带责任。同时,应要求平台建立AI侵权快速处置绿色通道。

另外,鼓励配音演员为独特声纹进行备案,以便在侵权发生时能够快速锁定权利归属,降低取证成本。最后,加快出台人工智能专项立法,明确AI训练数据获取的合规边界。区分AI技术用于创作的工具属性与恶意侵权(如电信诈骗、魔改丑化)的界限,对后者加大刑事打击力度。

“AI配音侵权正面临从‘技术无罪’向‘技术向善’的司法观念转变。”孙顺发说,虽然现阶段在取证和认定标准上仍有困难,但随着互联网法院等机构的标杆性判决出台,法律正在逐步收紧对技术滥用者的监管。“对于配音演员而言,主动进行权利备案、保留原始录音素材,并在发现侵权时及时采取公证取证,将是当前最有效的自我保护手段。”他建议。

【未经授权,严禁转载!联系电话028-86968276】